C. Scott Brown / Autoridade Android

DR

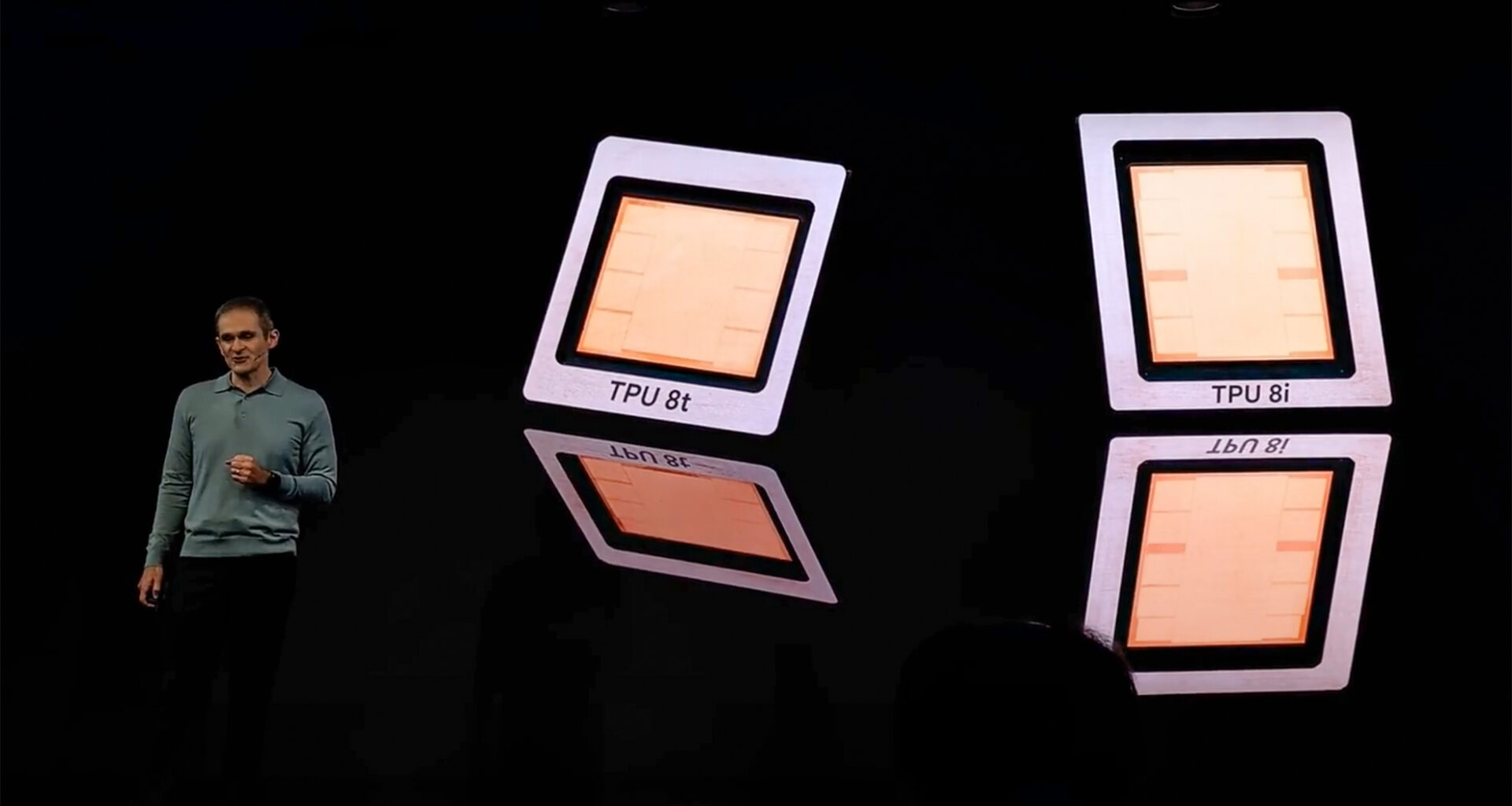

- O Google anunciou a oitava geração de Tensor Processing Units (TPUs) para seus data centers.

- A nova classe de TPUs é dividida com base no uso, com unidades separadas para treinamento e inferência.

- O Google afirma que isso reduz os requisitos de energia para o uso final real, o que, por sua vez, deverá beneficiar o meio ambiente.

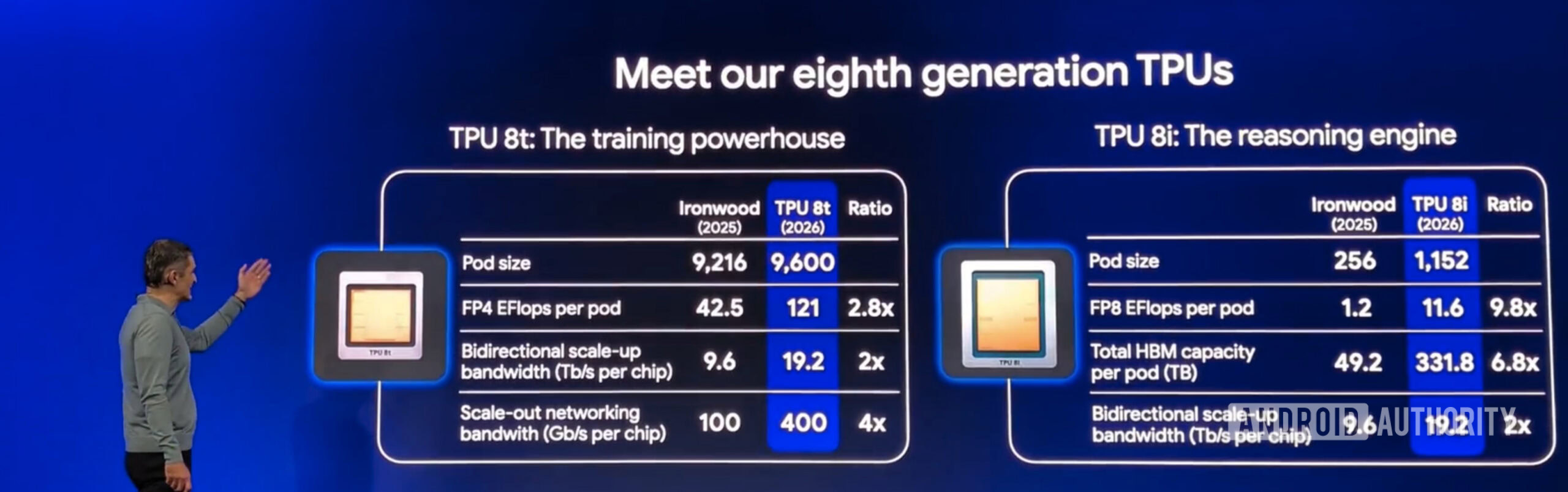

No ano passado, em seu evento Google Cloud Next, o Google anunciou a classe Ironwood de unidades de processamento tensor (TPUs) que alimentam seus data centers. Essas TPUs, projetadas para a era da IA, concentravam-se na inferência em larga escala ou na capacidade da IA de tirar conclusões ou fazer previsões com base no que foi treinado (basicamente o que os chatbots fazem), mas sem realmente saber a resposta já. Este ano, ela fez mais avanços no hardware da TPU e agora está dividindo a computação para servir treinamento e inferência de maneira diferente.

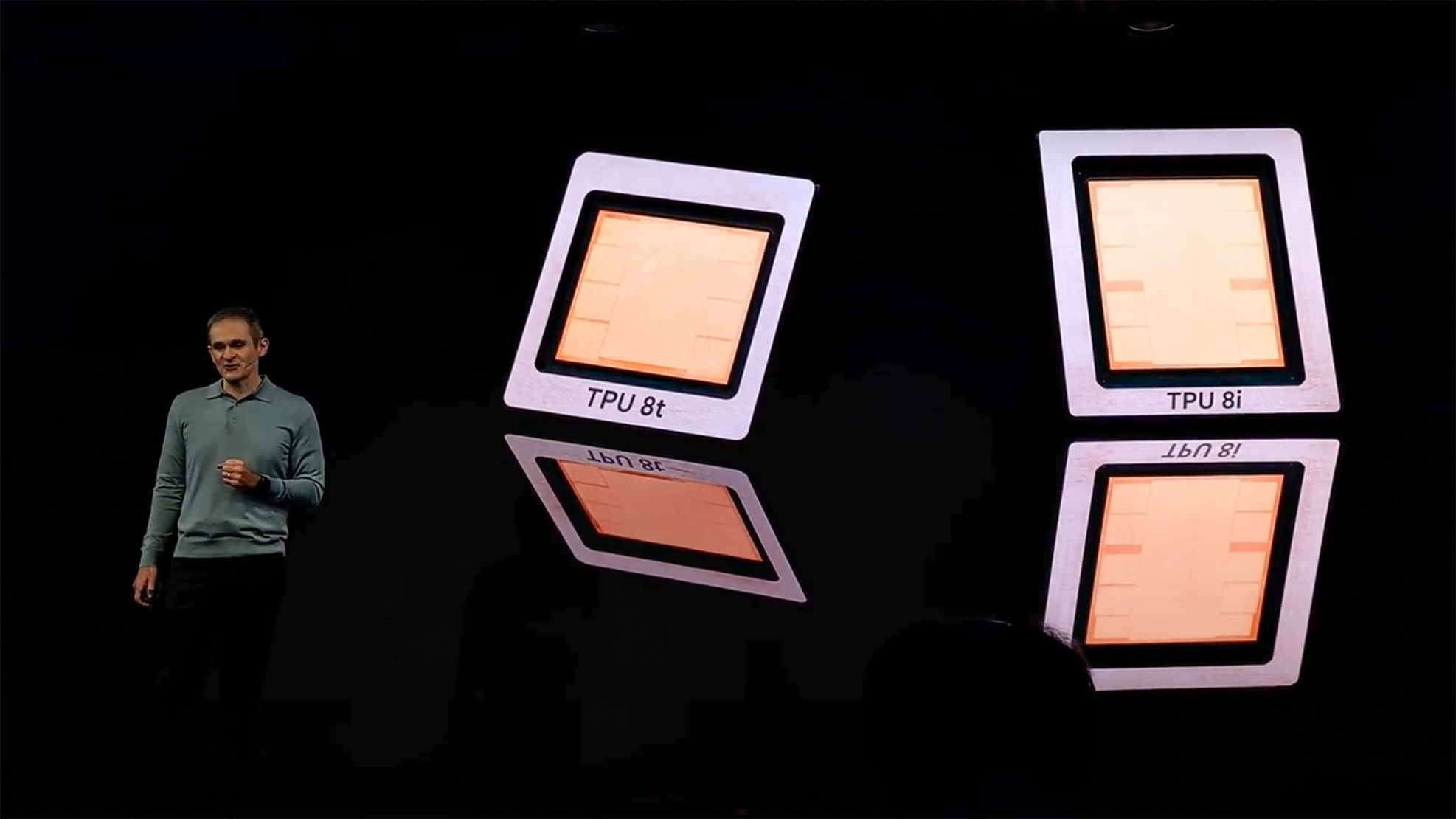

No Cloud Next 2026, o Google anunciou sua oitava geração de TPU, com diferentes arquiteturas para diferentes finalidades. As TPUs recém-introduzidas incluem a TPU 8t, que será usada para treinar modelos de IA, e a TPU 8i, que será específica para tarefas relacionadas a inferências.

O Google afirma que a divisão foi feita para atender aos diferentes requisitos de potência e computação de ambos os processos. A abordagem ajudará os seus centros de dados a reduzir o consumo de energia, reduzindo assim os custos operacionais e diminuindo os impactos negativos da IA no ambiente. Isso significa que o uso do Gemini poderá em breve consumir muito menos água (espero!) para manter os data centers resfriados.

Não quero perder o melhor de Autoridade Android?

O treinamento de redes neurais envolve memória de alta largura de banda e grandes clusters de unidades de processamento porque requer a atualização de bilhões de parâmetros a cada segundo. O treinamento envolve um processo denominado “propagação retroativa de erros”, que envolve inúmeros ciclos de feedback que testam e otimizam a rede neural no conjunto de treinamento até que ela comece a recuperar dados precisos. É basicamente como testar uma pessoa até que ela lhe diga a resposta correta.

Enquanto isso, a inferência é menos intensiva e pode ser processada em hardware menos capaz, com consumo de memória muito menor. Usar o mesmo hardware para treinamento e inferência resulta, portanto, em custos reais muito mais elevados, o que, por sua vez, aumenta o custo efetivo para tarefas relacionadas à inferência.

O Google já introduziu o TPU v5e (onde “e” supostamente significa eficiência) para operações em escala muito menor. A recente TPU 8i parece ser uma adaptação em grande escala baseada no hardware anterior. A Amazon também tem tentado alcançar o mesmo efeito com o AWS Inferentia.

Embora o Google tenha apontado os benefícios ambientais do uso de TPUs de raciocínio dedicado, não vimos nenhuma promessa de redução de custos. Resta saber se a Google irá transferir alguns dos benefícios para os seus consumidores ou reservar os lucros para si e para os seus aliados empresariais.

Obrigado por fazer parte da nossa comunidade. Leia nossa Política de Comentários antes de postar.