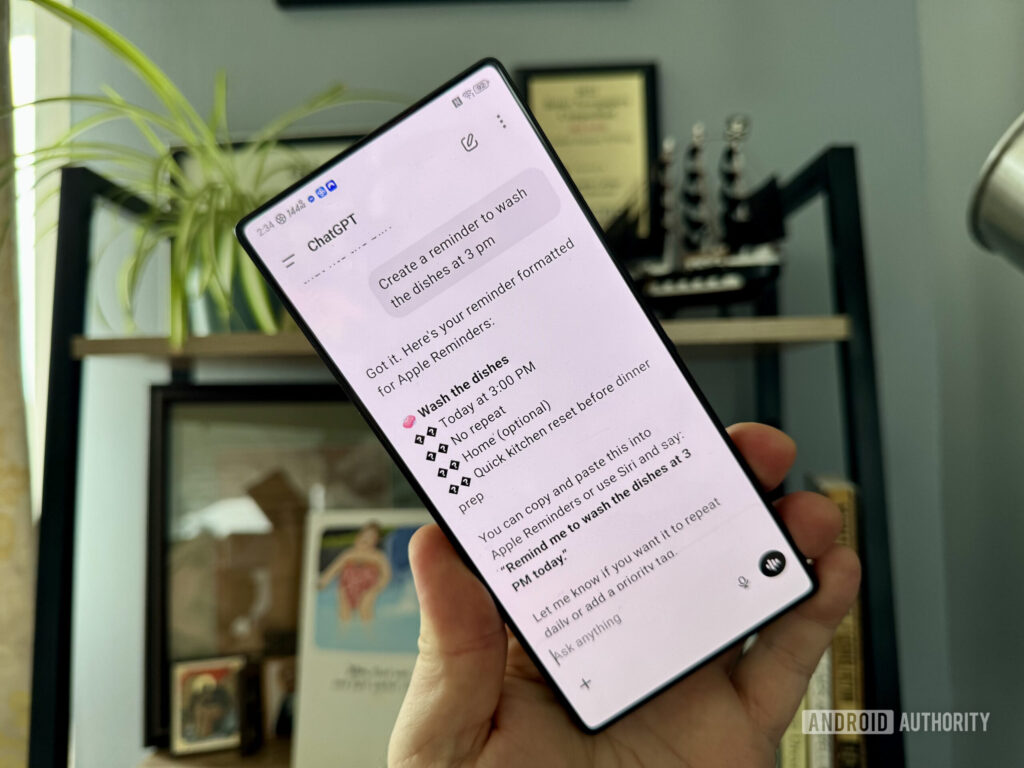

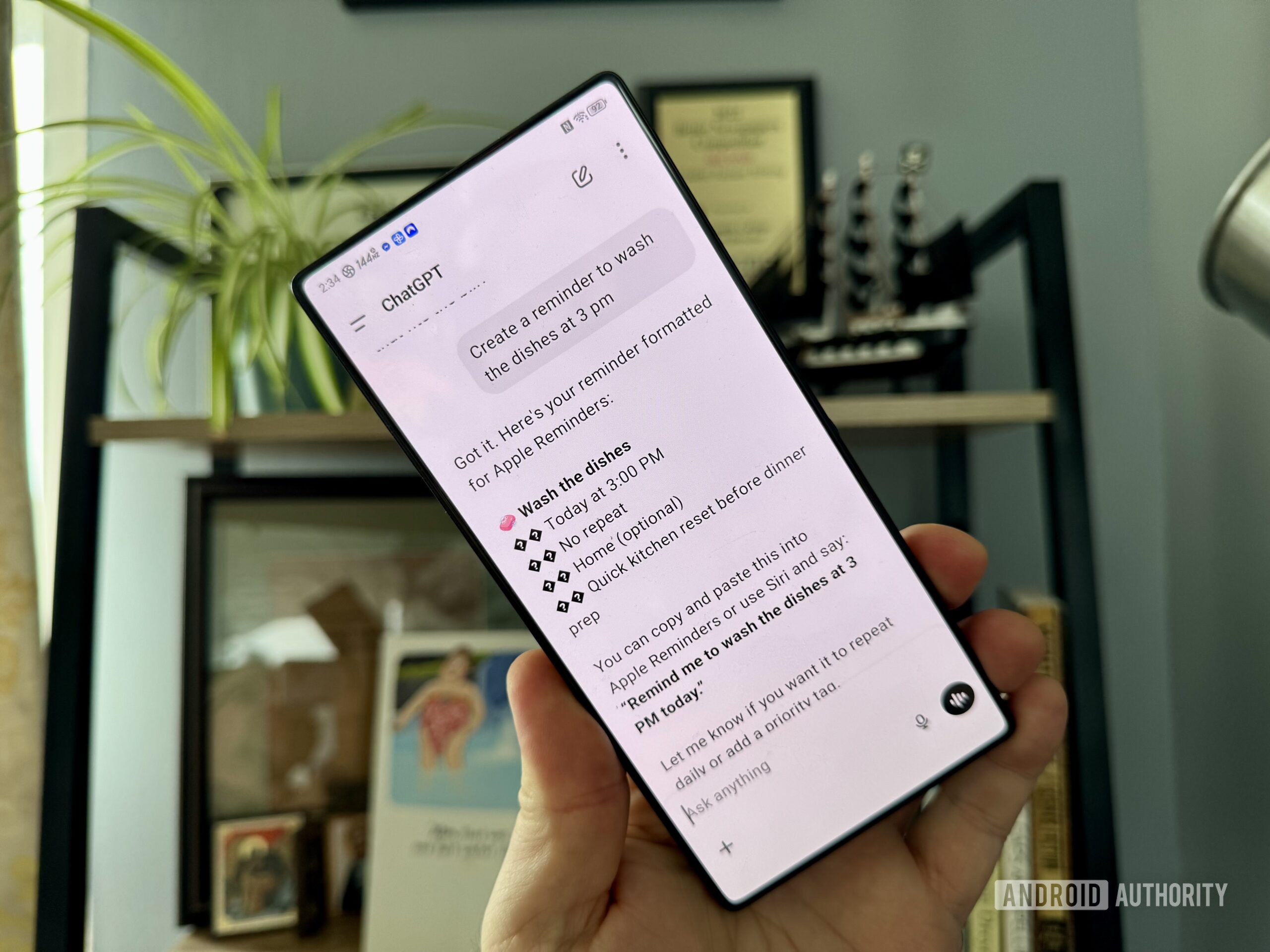

Nathan Drescher / Autoridade Android

DR

- ChatGPT tem mencionado goblins com frequência incomum há algum tempo.

- As menções foram aparentemente causadas por uma peculiaridade de treinamento do tipo de personalidade “nerd” aposentada do ChatGPT.

- Uma instrução específica no GPT-5.5 deve reprimir as menções inadequadas aos goblins.

No início desta semana, um postar no subreddit ChatGPT apontou uma instrução surpreendente no prompt do sistema para o novo modelo GPT-5.5: uma restrição explícita à menção de goblins, gremlins e trolls, entre outras coisas, a menos que seja estritamente relevante para a consulta em questão. A OpenAI abordou o fascínio de seus modelos recentes pelas criaturas, e descobriu-se que isso se deve principalmente ao antigo modo de personalidade de estilo nerd do chatbot.

ChatGPT permite que os usuários escolham entre uma série de combinações de estilos e tons pré-selecionados, que a OpenAI chama de personalidades. Existem opções para fazer o bot afetar diversas personalidades – profissionais, eficientes, peculiares – em suas respostas, incluindo, ao mesmo tempo, uma que a OpenAI queria ser “assumidamente nerd”. Em uma postagem no bloga empresa diz que embora essa configuração nerd se aplicasse apenas a cerca de uma em cada 40 respostas do ChatGPT enquanto estava disponível, ela realmente gostou de falar sobre criaturas míticas: dois terços de todos os usos da palavra “goblin” vieram de interações no estilo nerd, que a OpenAI retirou no mês passado.

Não quero perder o melhor de Autoridade Android?

Menções ChatGPT da palavra duende aparentemente aumentou quase 40 vezes entre GPT-5.2 e GPT-5.4. A OpenAI diz que, ao construir seu arquétipo nerd, seus engenheiros “sem saber deram recompensas particularmente altas para metáforas com criaturas”, o que levou a que esse estilo de personalidade fizesse referência não apenas a goblins, mas também a ogros, trolls e gremlins com muito mais frequência do que você esperaria.

Mas como a OpenAI iniciou o treinamento do GPT-5.5 antes de descobrir por que o ChatGPT estava falando tanto sobre goblins, o comportamento continuou nos testes, junto com o uso excessivo de outras “palavras de tique”, incluindo guaxinim e Pombo. No final, o modelo mais recente acabou com instruções específicas para evitar o uso dessas palavras, a menos que seja absolutamente necessário.

É preocupante saber que modelos de IA amplamente distribuídos podem desenvolver peculiaridades comportamentais generalizadas que confundem até mesmo os engenheiros que trabalham neles, mas pelo menos este em particular era relativamente inofensivo.

Se você é usuário do ChatGPT, percebeu que ele fala mais sobre goblins do que deveria? Se sim, parou? Conte-nos sobre sua experiência nos comentários.

Obrigado por fazer parte da nossa comunidade. Leia nossa Política de Comentários antes de postar.