A startup de IA Anthropic, apoiada por centenas de milhões em capital de risco (e talvez em breve centenas de milhões a mais), hoje anunciado a versão mais recente de sua tecnologia GenAI, Claude. E a empresa afirma que rivaliza com o GPT-4 da OpenAI em termos de desempenho.

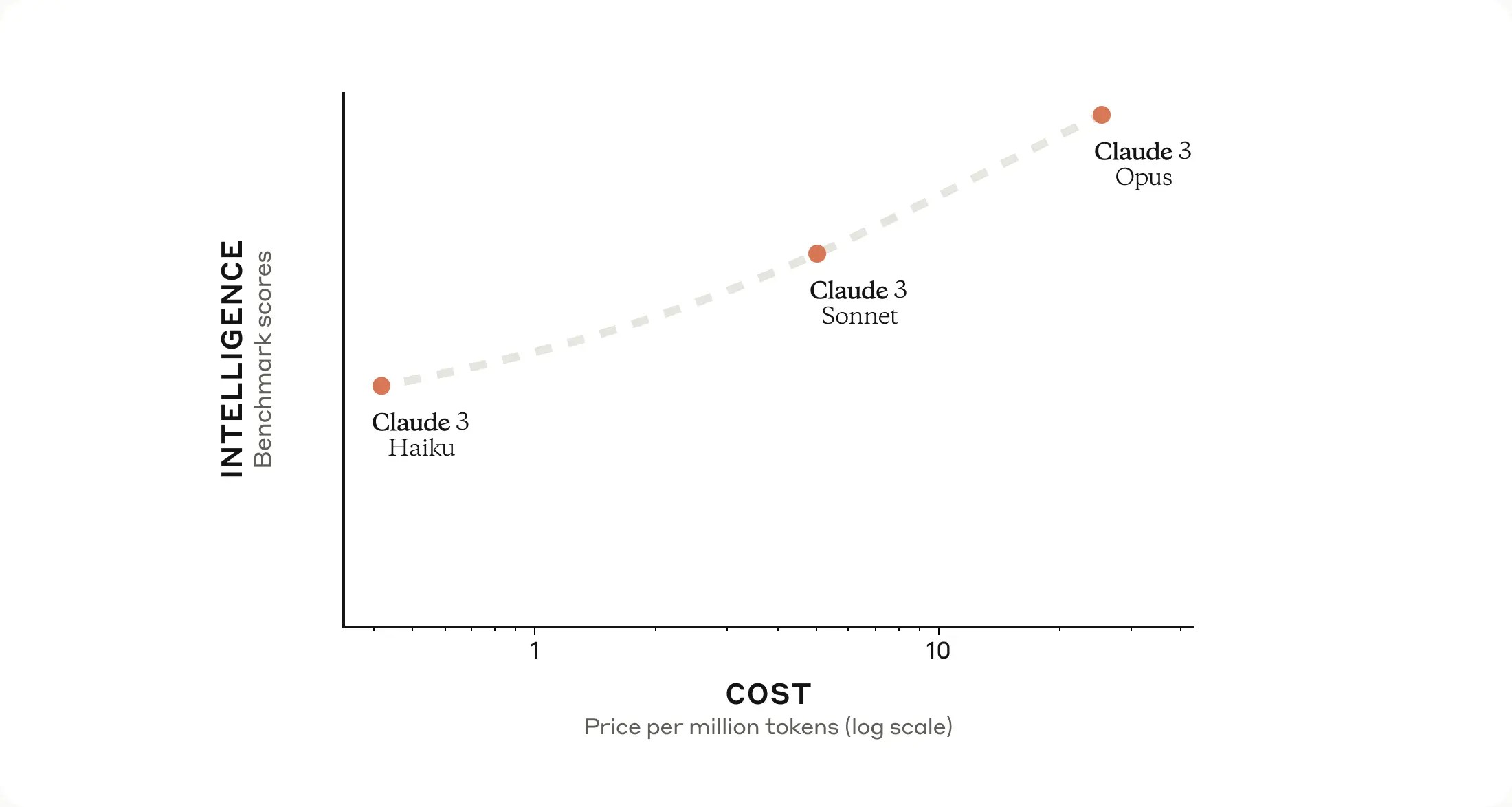

Claude 3, como é chamado o novo GenAI da Anthropic, é uma família de modelos – Claude 3 Haiku, Claude 3 Sonnet e Claude 3 Opus, sendo Opus o mais poderoso. Todos mostram “capacidades aumentadas” em análise e previsão, afirma a Anthropic, bem como desempenho aprimorado em benchmarks específicos em comparação com modelos como GPT-4 (mas não GPT-4 Turbo) e Gemini 1.0 Ultra do Google (mas não Gemini 1.5 Pro).

Notavelmente, Claude 3 é o primeiro GenAI multimodal da Anthropic, o que significa que ele pode analisar tanto texto quanto imagens – semelhante a alguns sabores de GPT-4 e Gemini. Claude 3 pode processar fotos, tabelas, gráficos e diagramas técnicos, desenhando a partir de PDFs, apresentações de slides e outros tipos de documentos.

Num passo melhor do que alguns rivais da GenAI, o Claude 3 pode analisar múltiplas imagens em uma única solicitação (até um máximo de 20). Isso permite comparar e contrastar imagens, observa a Anthropic.

Mas há limites para o processamento de imagens de Claude 3.

A Antrópica impediu que os modelos identificassem pessoas – sem dúvida cautelosos com as implicações éticas e legais. E a empresa admite que Claude 3 é propenso a cometer erros com imagens de “baixa qualidade” (abaixo de 200 pixels) e tem dificuldades com tarefas que envolvem raciocínio espacial (por exemplo, leitura de um mostrador de relógio analógico) e contagem de objetos (Claude 3 não consegue fornecer dados exatos). contagens de objetos em imagens).

Créditos da imagem: Antrópico

Claude 3 também não gerar obra de arte. Os modelos analisam estritamente imagens – pelo menos por enquanto.

Seja no campo de texto ou imagens, a Anthropic diz que os clientes geralmente podem esperar que o Claude 3 siga melhor as instruções de várias etapas, produza resultados estruturados em formatos como JSON e conversar em outros idiomas além do inglês em comparação com seus antecessores. Claude 3 também deveria se recusar a responder perguntas com menos frequência, graças a uma “compreensão mais sutil das solicitações”, diz a Anthropic. E em breve, os modelos citarão a fonte de suas respostas às perguntas para que os usuários possam verificá-las.

“Claude 3 tende a gerar respostas mais expressivas e envolventes”, escreve a Anthropic em um artigo de apoio. “[It’s] mais fácil de solicitar e orientar em comparação com nossos modelos legados. Os usuários devem descobrir que podem alcançar os resultados desejados com instruções mais curtas e concisas.”

Algumas dessas melhorias decorrem do contexto ampliado de Claude 3.

O contexto de um modelo, ou janela de contexto, refere-se aos dados de entrada (por exemplo, texto) que o modelo considera antes de gerar a saída. Modelos com pequenas janelas de contexto tendem a “esquecer” o conteúdo até mesmo de conversas muito recentes, levando-os a desviar-se do assunto – muitas vezes de maneiras problemáticas. Como vantagem adicional, os modelos de grande contexto podem compreender melhor o fluxo narrativo de dados que captam e gerar respostas mais contextualmente ricas (pelo menos hipoteticamente).

A Anthropic diz que o Claude 3 suportará inicialmente uma janela de contexto de 200.000 tokens, equivalente a cerca de 150.000 palavras, com clientes selecionados obtendo uma janela de contexto de 1 milhão de tokens (~700.000 palavras). Isso está no mesmo nível do mais novo modelo GenAI do Google, o mencionado Gemini 1.5 Pro, que também oferece uma janela de contexto de até um milhão de tokens.

Agora, só porque Claude 3 é uma atualização em relação ao que veio antes, não significa que seja perfeito.

Em uma técnica papel branco, A Anthropic admite que Claude 3 não está imune aos problemas que assolam outros modelos GenAI, nomeadamente preconceitos e alucinações (ou seja, inventar coisas). Ao contrário de alguns modelos GenAI, Claude 3 não pode pesquisar na web; os modelos só podem responder a perguntas usando dados anteriores a agosto de 2023. E embora Claude seja multilíngue, não é tão fluente em certos idiomas de “poucos recursos” em comparação com o inglês.

Mas as promissoras atualizações frequentes da Anthropic para Claude 3 nos próximos meses.

“Não acreditamos que a inteligência do modelo esteja perto dos seus limites e planejamos lançar [enhancements] à família de modelos Claude 3 nos próximos meses”, escreve a empresa em um postagem no blog.

Opus e Sonnet já estão disponíveis na web e por meio do console de desenvolvimento e API da Anthropic, da plataforma Bedrock da Amazon e do Vertex AI do Google. Haiku virá ainda este ano.

Aqui está o detalhamento dos preços:

- Opus: US$ 15 por milhão de tokens de entrada, US$ 75 por milhão de tokens de saída

- Soneto: US$ 3 por milhão de tokens de entrada, US$ 15 por milhão de tokens de saída

- Haiku: US$ 0,25 por milhão de tokens de entrada, US$ 1,25 por milhão de tokens de saída

Então esse é Claude 3. Mas qual é a visão de 30.000 pés de tudo isso?

Bem, como já relatado anteriormente, a ambição da Anthropic era criar um algoritmo de última geração para “autoaprendizagem de IA”. Tal algoritmo poderia ser usado para construir assistentes virtuais que podem responder e-mails, realizar pesquisas e gerar arte, livros e muito mais – alguns dos quais já experimentamos com nomes como GPT-4 e outros grandes modelos de linguagem.

A Anthropic sugere isso na postagem do blog mencionada, dizendo que planeja adicionar recursos ao Claude 3 que melhorem suas capacidades imediatas, permitindo que Claude interaja com outros sistemas, codifique “interativamente” e forneça “capacidades de agente avançadas”. .”

Essa última parte lembra o OpenAI relatado ambiciona construir um agente de software para automatizar tarefas complexas, como transferir dados de um documento para uma planilha ou preencher automaticamente relatórios de despesas e inseri-los em um software de contabilidade. A OpenAI já oferece uma API que permite aos desenvolvedores criar “experiências semelhantes a agentes” em seus aplicativos, e a Anthropic, ao que parece, pretende fornecer funcionalidades comparáveis.

Poderíamos ver um gerador de imagens da Anthropic a seguir? Isso me surpreenderia, francamente. Os geradores de imagens são objeto de muita controvérsia atualmente, principalmente por razões relacionadas a direitos autorais e preconceitos. O Google foi recentemente forçado a desativar seu gerador de imagens depois de injetar diversidade nas imagens com um desrespeito ridículo pelo contexto histórico. E vários fornecedores de geradores de imagens estão em batalhas legais com artistas que os acusam de lucrar com seu trabalho treinando GenAI nesse trabalho sem fornecer compensação ou mesmo crédito.

Estou curioso para ver a evolução da técnica da Anthropic para treinamento de GenAI, “IA constitucional”, que a empresa afirma tornar o comportamento de sua GenAI mais fácil de entender, mais previsível e mais simples de ajustar conforme necessário. A IA Constitucional visa fornecer uma maneira de alinhar a IA com as intenções humanas, fazendo com que os modelos respondam a perguntas e executem tarefas usando um conjunto simples de princípios orientadores. Por exemplo, para Claude 3, a Anthropic disse que adicionou um princípio – baseado em feedback de crowdsourcing – que instrui os modelos a serem compreensíveis e acessíveis às pessoas com deficiência.

Qualquer que seja o objetivo final da Antrópico, ele estará presente no longo prazo. De acordo com uma apresentação vazada em maio do ano passado, a empresa pretende arrecadar até US$ 5 bilhões nos próximos 12 meses ou mais – o que pode ser apenas a linha de base necessária para permanecer competitiva com a OpenAI. (Afinal, os modelos de formação não são baratos.) Está no bom caminho, com 2 mil milhões e 4 mil milhões de dólares em capital comprometido e promessas da Google e da Amazon, respetivamente, e bem mais de mil milhões de dólares combinados de outros financiadores.

Link do Autor